Sobre el índice de refracción

...O index of refraction.

Antes de nada, definamos algunos términos básicos.

Normal incidence: Es el punto de una superficie que mira de forma más directa a la cámara. En el caso de una esfera, en una vista frontal, el centro de la misma sería el punto más directo que mira a cámara, y lo que consideraríamos normal incidence.

Fresnel: Todos los materiales se ven afectados por él, y basicamente dicta la apariencia de la reflexión.

A 90° el fresnel es igual a 1 y el comportamiento del fresnel en su viaje desde 0° a 90° determinará la respuesta de la reflexión en toda la superficie.

Dielectric materials

- Todos aquellos materiales que solo reflejan el color de la luz, no se da ningún tipo de absorción antes de que la luz sea reflejada.

Una vez la luz impacta en su superficie, esta puede reflejar o ser absorbida y/o transmitida por la propia superficie. - Generalmente el IOR tiene un valor alrededor de 1.5 o 1.6

- El fresnel suele ser muy pronunciado.

- La reflexión tiende a ser de color blanco.

- Materiales comunes suelen ser plástico, madera, cristal, piel, etc.

- Para este tipo de materiales basta con utilizar un valor para el eta o index of refraction (real part of complex index of refraction).

Conductor materials

- Materiales que reflejan la luz después de la absorción.

- La cantidad de absorción esta basada en el valor kappa o extinction coefficient (imaginary part of complex index of refraction).

- Parte de la luz absorbida puede extinguirse o transformarse en calor.

- El color de la reflexión tiende a tintarse del color de las fuentes lumínicas.

- Básicamente todos los metales formarían parte de este tipo de materiales.

Calcular los valores correctos

Para calcular los valores correctos para tus materiales, eta y kappa trabajan conjuntamente, salvo que estés creando un material dielectric que solo utiliza eta.

Aumentar el valor de eta incrementará el índice de refracción de la superficie, y aumentar el valor de kappa significará menos luz absorbida y mayor reflexión.

Utilizar valores reales significará que tus shaders se comporten de la forma correcta.

Hay varias formas de realizar esta tarea. Lo primero es buscar una medida real para tu material. Si tienes un reflectance detector puedes utilizarlo. Si no, puedes ayudarte de sitios como http://refractiveindex.info/

Seguramente no dispongas de un reflectance detector a menos que trabajes en un estudio de VFX muy especializado, en el laboratorio de una universidad, etc.

Si utilizas http://refractiveindex.info/ primero, selecciona el tipo de material en la web, por ejemplo aluminio. Aluminio es un conductor, así que tendremos información de eta y kappa. Necesitamos obtener el valor de ambos para cada wavelength, Red, Green and Blue.

RED = 0.7µm

GREEN = 0.53µm

BLUE = 0.47µm

Introduce los valores en el campo y dale al enter, la web te mostrará los valores de eta y kappa para cada wavelength. Si solo te da el valor de eta, significa que estas utilizando un dielectric material, y el kappa debe ser 0.

En el caso del aluminio estos son los valores.

eta[r] = 1.92139

eta[g] = 0.930287

eta[b] = 0.70362

kappa[r] = 8.1420

kappa[g] = 6.3965

kappa[b] = 5.6953

Si comprobamos plásticos o polycarbonatos, obtendremos algo similar a esto, sin valor para kappa ya que estamos hablando de dielectric materials.

eta[r] = 1.57508

eta[g] = 1.59243

eta[b] = 1.60246

Aquí dejo algunos de los valores para materiales comunmente utilizados.

Autobracketing sin remote shutter con Nikon D800

Sin saber como, y de pura casualidad (entre otras cosas porque no tiene ninguna lógica) he encontrado una opción en mi Nikon D800 que sirve para realizar secuencias de brackets (múltiples exposiciones) con una sola pulsación del shutter release, sin utilizar ningún remote shutter o mando a distancia.

La cosa es que hace unos días se me estropeó la conexión de pines de mi cámara, donde se conecta el remote shutter, que es esa herramienta indispensable para realizar múltiples exposiciones o brackets.

La lógica detrás de los brackets, es mantener la cámara siempre en la misma posición exacta, para después fusionar los brackets en el ordenador y así crear una imagene HDR. Si al mismo tiempo, esto mismo lo haces desde varios ángulos, rotando la cámara desde su propio centro, conseguirás unos fabulosos panoramas HDR cubriendo un rango dinámico muy amplio de exposiciones, que básicamente es lo que hago para akromatic.

No utilizar un remote shutter es prácticamente inviable para esta tarea, ya que si presionas el disparador de la cámara para cada exposición, estarás moviendo ligeramente la cámara, y creando de forma inconsciente problemas de ghosting, de los que te percatarás más adelante en postproducción.

Con mi conexión rota para el remote shutter, solo me quedaba llevar la cámara al taller, pero mis experiencias previas con el servicio técnico de Nikon, me decían que iba a estar al menos un mes sin cámara, cosa que no puedo permitirme, y la única alternativa real al remote shutter es el CamRanger que va por puerto USB y wifi. (pero tampoco encontraba donde comprarlo en Londres).

Buscando por internet, descubrí que parece ser que la Nikon D800 tiene un problema de fabricación con este conector de pines, o al menos, hay cientos de usuarios con el mismo problema, así que deduzco son muchos los que tarde o temprano se van a encontrar con esta desafortunada situación.

La parte positiva, es que rebuscando por los menúes de la cámara, encontré una opción, que no tiene ninguna lógica, pero precisamente hace lo que necesito, disparar todos los brackets programados en la cámara con una sola pulsación del disparador. Si a esto le sumamos la opción de disparar automáticamente pasados unos segundos, podemos estar completamente seguros de que nuestras exposiciones múltiples van a estar perfectas, ya que no habrá ningún tipo de vibración de cámara entre exposiciones, ni siquiera en la primera ya que se autodispara después de los segundos que le indiques.

Esto es lo que hay que hacer para activar esta opción.

- Antes de nada, activa la cantidad de brackets necesarios y la diferencia de exposición entre ellos.

- Activa el autodisparador.

En el menú, vete al apartado timer y después a self timer. Ahí en la opción self timer delay puedes especificar el tiempo del autodisparador.

- Justo debajo de la opción self timer delay, hay otra opción llamada number of shots. Bien, esta es la opción clave y a la que no le encuentro el sentido, pero simplemente funciona. Verás que puedes poner varios números ahí, si pones el numero 2, con una sola pulsación del disparador saltarán todos los brackets.

- Finalmente puedes configurar el tiempo entre cada una de las exposiciones, yo lo tengo a 0.5 y es más que suficiente, ya que nunca mueves la cámara entre exposiciones.

Y con esto ya está, bastará una sola pulsación del disparador para que se realicen de forma automática toda la secuencia de imágenes.

La luz

A Woman Holding a Balance by Johannes Vermeer

Este es el primero de una serie de artículos que voy a escribir acerca de la iluminación.

Trataré los mismos desde un punto de vista teórico/práctico, acudiendo a la historia del arte y a la comunicación audiovisual como referentes, pero siempre extrapolando los conceptos y términos a las nuevas metodologías de iluminación digital aplicadas a proyectos de animación 3D y efectos visuales digitales.

Como nota, utilizaré algunos términos en inglés, de fácil comprensión, debido a que el inglés es la lengua predominante en las producciones cinematográficas internacionales, y a que en inglés están escritos la mayor parte de programas educativos sobre lenguaje cinematográfico y cinematografía.

Empecemos pues por la luz.

En cualquier medio artístico, la función de la luz es definir espacios tridimensionales en una superficie bidimensional. Por ejemplo, en una pintura, una fotografía o la pantalla de un cine.

A través de la luz, podemos describir la relación espacial entre objetos, definir los volúmenes internos de los mismos y determinar su tamaño relativo y profundidad.

Aparte del color (del que hablaré más adelante) la luz tiene tres propiedades básicas.

- Dirección/disposición

- Intensidad

- Dureza/suavidad

Estas propiedades se combinan para crear el juego de luces y sombras que definirá la mayoría de nuestro estudio en esta sección.

A lo largo de la historia del arte, la representación de la figura humana, y del rostro humano en particular, siempre ha estado a la vanguardia de la creación artística. Probablemente porque el rostro humano es algo que identificamos emocionalmente a la perfección, con un solo golpe de vista.

Muchas técnicas han sido desarrolladas y perfeccionadas a lo largo de los siglos, cada una de ellas, provocando diferentes respuestas emocionales.

La mayoría de estas técnicas pueden ser también utilizadas para describir otras superficies, tales como paisajes o interiores. Por ejemplo, "horror lighting" en el rostro de un personaje, se consigue prácticamente del mismo modo que aplicando dicha técnica sobre un edificio.

Pese a que una superficie puede ser iluminada utilizando diferentes técnicas, hay unos estilos básicos definidos que se han utilizado a lo largo de los años, debido a su éxito en la transmisión de un significado específico.

Podríamos resumirlos en:

- Beauty lighting

- Character lighting

- Dramatic lighting

- Comedy lighting

Beauty lighting

Ginevra de' Benci by Leonardo da Vinci

Esta pintura, ejecutada en el apogeo del Renacimiento, demuestra las aptitudes técnicas y estéticas que los artistas habían alcanzado ya en el siglo XV.

La iluminación es naturalista y muy suave, la pintura se aplica muy finamente, capa tras capa para crear una impresión tridimensional, pero sin bordes duros o sombras muy marcadas.

Esta técnica de aplicar pintura por capas es conocida como "sfumato", de la palabra italiana "fumo".

Las formas y sombras son suaves, creando una belleza serena. La piel, limpia, sin imperfecciones, sin sombras duras bajo la nariz.

La piel casi parece que brilla y no hay prácticamente nada en penumbra.

La Gioconda by Leonardo da Vinci

La Mona Lisa, también de Leonardo, ejecutada mediante la técnica del sfumato.

De nuevo podemos ver todas las superficies de forma clara, sin detalles precisos o imperfecciones.

El principio central de este tipo de iluminación, es presentar una composición armoniosa, cambiando suavemente de valor, de forma gradual, sin elementos visuales discordantes.

Este look ha definido la idea pictórica de belleza en la cultura occidental, asociada a la juventud, ya que la piel siempre es suave y libre de imperfecciones.

Y también como ideal femenino de belleza, suavidad de formas y curvas por encima de bordes duros.

Esta técnica esta tan arraigada dentro de la creación pictórica, que en el momento en que los fotógrafos empezaron a realizar retratos femeninos, recurrieron sin dudarlo a estos principios renacentistas.

Greta Garbo

Los dos elementos principales en este estilo de iluminación son.

- El posicionamiento de la "key light" (luz principal), arriba y a un lado del sujeto, y con intensidad muy alta, pero con la que se consiga un buen rango tonal.

- Un buen nivel de "fill light" (luz de relleno) suave, para eliminar las sombras no deseadas y suavizar las formas.

- Un añadido final es normalmente la incorporación de una "rim light" (luz de perfilado) colocada tras el sujeto, en el lado opuesto a la "key light". Esta luz generalmente solo apunta el sujeto en cuestión, creando una fina linea de luz, dibujando la silueta del sujeto. Si hay pelo o pelaje, se creará un halo de luz, como se puede observar en la imagen de Greta.

Representación en 3D

En este ejemplo en 3D podemos ver claramente la "key light", la "soft light" y la "rim light".

La "key light" es la luz principal que define la forma del objeto, la "fill light" rellena la zona que estaba en penumbra y la "rim light" dibuja la silueta de la esfera para separarla del fondo.

Si el fondo fuese brillante o blanco, podríamos prescindir de la "rim light", ya que seríamos capaces de identificar el volumen del objeto sin mayor dificultad.

En este ejemplo, la luz también ayuda a dirigir la mirada del espectador al foco de atención, la bola.

Hay un poco de luz bajo la ventana, en el fondo, que podría causar distracción en el espectador, pero tal y como esta iluminada la escena, pasa casi desapercibida al ojo humano, forzándonos a dirigir nuestra atención hacia la bola.

Lauren Bacall

En este ejemplo la "key light" es más dura e intensa, con las sombras más definidas y marcadas.

La sombra bajo la nariz se aprecia de forma inmediata, dura y definida, pero el angulo de la luz ha sido tratado con mucho cuidado para que la sombra sea pequeña y discreta.

Este tipo de iluminación es mas dramático, también acorde con la fuerte personalidad que caracterizaba a Bacall. Aun así, este tipo de iluminación conserva un aire glamuroso evidente.

Podemos apreciar todo su rostro, incluso las zonas en sombra. La mezcla de maquillaje e iluminación le dan a la piel un aspecto de porcelana, realzando los pómulos. El ángulo de la luz y la disposición de las sombras, enmarcan el rostro de Bacall y guían la vista del espectador.

Ya que el fondo es brillante, se ha prescindido de la "rim light", que además en este caso, habría sido contraproducente, ya que hubiese desviado la atención del espectador hacia otro foco de atención no deseado.

La iluminacion dramática en el retrato de Bacall, nos muestra un mayor contraste, áreas fuertemente iluminadas contra áreas oscuras, bordes duros, sombras muy definidas, etc. Combinados para conseguir una imagen más impactante, con más fuerza visual.

También nos muestra como la iluminación puede añadir información sobre un personaje. El carácter de Bacall es más fuerte que el de Garbo y eso también queda patente en sus retratos, a través de la eleccion lumínica por parte del fotógrafo.

Mediante estos dos ejemplos podemos ver como la fotografía de retrato, por ejemplo para campañas de moda, puede decirnos mucho más de los modelos que simplemente mostrarnos que son fotogénicos. En esencia, puede darnos información de quienes son y contarnos de forma condensada parte de su historia.

Eso es precisamente lo que llamamos iluminación centrada en personajes, o "character lighting", de la que hablaré en la próxima entrada.

De Mari a Modo con un click

Desde hace unos 10 o 12 años, UDIM ha sido el método de UV Mapping más utilizado en la industria de los VFX. Desde hace 4 o 5 años aproximadamente, cuando Mari empezó a ser popular y abierto a profesionales fuera de los grandes estudios, UDIM se ha expandido a todos los niveles.

Poco a poco, las empresas responsables por software 3D, o motores de render, han ido adaptando sus herramientas para que trabajar con UDIM sea cada vez más sencillo.

Si eres usuario de Maya y Arnold o VRay, seguro que vienes utilizando los "tokens" que ofrecen desde hace un tiempo.

Hasta ahora en Modo, había que configurar cada mapa de textura con la coordenada correspondiente de UDIM, lo que suponía un dolor de cabeza, especialmente si trabajas con assets de 50 UDIMs o más.

Con la nueva version de Modo 801, trabajar con UDIM es incluso más sencillo.

Basta con exportar los mapas desde Mari y cargarlos en Modo con la opción "load UDIM".

Aquí dejo el sencillo procedimiento que hay que seguir.

- Exporta tus mapas desde Mari. A mi me gusta utilizar la nomenclatura componente_UDIM.exr por ejemplo RGB_1001.exr

- Asigna un nuevo material a tu asset.

- Añade encima del material una textura mediante la opción add layer -> image map -> load udims.

- Selecciona la secuencia de UDIMs.

- Cambia el effect para afectar al channel deseado, como has hecho siempre.

- Fíjate que en las opciones de UV Map ya vienen por defecto la opción Use Clip UDIM, así que no tienes que preocuparte de nada, Modo ya se encarga solito de leer las coordenadas UDIM.

Ya está, no necesitas hacer nada mas :)

- Como extra, puedes ir al image manger y seleccionar un mapa de textura. Verás como en las propiedades UV te muestra la coordenada UDIM a la que pertenece.

- También en esta misma ventana de propiedades, bajo color -> colorspace puedes cambiar el espacio de color de una secuencia completa de UDIMs con un solo click, lo que viene genial si trabajas mediante Linear Workflow o cualquier otro espacio de color.

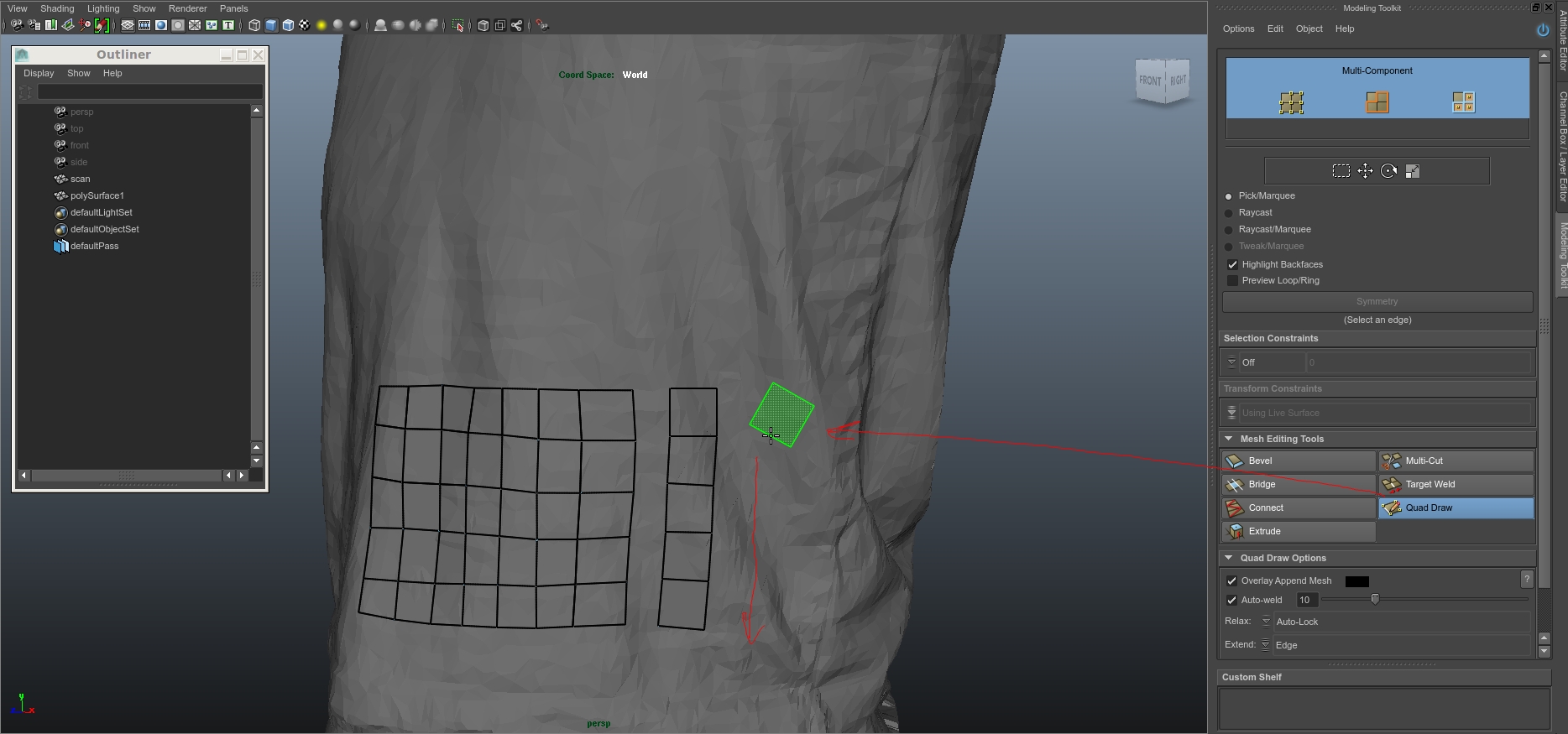

Retopología en Maya 2014, trabajando con scans 3D

Hoy en día en cualquier producción cinematográfica donde hay presentes VFX, utilizamos scanners 3D. Bien sea a través de Lidar, photogrammetry o cualquier otra técnica, pero los scans 3D son uno de los recursos más utilizados y además, uno de las más útiles para crear assets de gran calidad.

Un scan 3D por si mismo no sirve para nada, pero si lo tratamos con cuidado puede ser de gran utilidad para extraer información de volumen, detalles para aplicar como displacement map, texturas fotográficas, etc.

Hay muchas formas y diferentes herramientas para procesar scans 3D, pero en Maya 2014 han incorporado unas cuantas, que si bien son muy básicas, cumplen su función a la perfección.

Es decir, son muy sencillas de utilizar y funcionan bien.

Llevo un tiempo utilizándolas para procesar los scans 3D con los que tengo que trabajar en mi día a día, así que sin mas, paso a nombrarlas y explicar un poco como las utilizo.

- En este scan 3D puede verse la cantidad de detalle presente. Toda esa información nos viene genial para extraerla y utilizarla de un montón de formas diferentes.

- Cuando chequeamos la topología del scan 3D, salta a la vista de que es una topología que no sirve para trabajar, incluso habiendo sido ya procesada y limpiada utilizando el software específico del scanner 3D.

Paso a contaros como yo utilizo las nuevas herramientas de Maya 2014 para este propósito.

- Me creo una nueva capa donde meto el scan 3D.

- A esta capa, le activo la opción reference, para evitar seleccionar el scan en viewport.

- En las opciones de snap, seleccionar como Live Surface el scan 3D.

- Activar el Modeling Kit.

- En el apartado Transform Constraints, chequear Using Live Surface.

- Esto hará que el scan 3D sea la base para nuestro modelado, y cualquier operación que hagamos se adapte automáticamente a la superficie del scan 3D.

- La herramienta Quad Draw nos permite dibujar polígonos sobre la superficie del scan 3D.

- Dibujando 4 puntos se creará un polígono.

- Una vez definidos los 4 puntos, si presionamos shift mientras situamos el cursor del mouse dentro de los 4 puntos, veremos un preview del polígono que estamos creando.

- Para crear el polígono, simplemente hacemos click.

- Podemos definir tantos puntos para crear polígonos como queramos.

- LMB para crear puntos, MMB para mover puntos/edges/polys y CTRL+LMB para borrar puntos/edges/polys. CTRL+MMB para mover edge loops.

- Si quieres extruir edges de polígonos ya creados, basta con presionar CTRL+SHIFT+LMB y tirar del edge deseado.

- Para añadir edge loops: SHIFT+LMB.

- Para añadir edge loops justo en el centro: SHIFT+MMB.

- Para dibujar polígonos "on the fly" simplemente presiona CTRL+SHIFT+LMB y dibuja en cualquier dirección.

- Para cambiar el tamaño de los polígonos presiona CTRL+SHIFT+MMB.

- Para juntar dos polígonos separados, creando un nuevo polígono, SHIFT+LMB en el espacio entre ambos polígonos.

- Para soldar puntos, CTRL+MMB.

Cuando nos encontramos objetos cilíndricos, rectangulares, tubulares, etc, es incluso más sencillo hacer retopología.

- Creamos un volumen suficientemente grande para contener el objeto de referencia. En este caso, un brazo.

- En las opciones del Modeling Toolkit, vamos a edit -> Shrinkwrap Selection.

- El volumen cilíndrico se adaptará a la forma de referencia.

- Si la topología no se queda todo lo ordenada que te hubiese gustado, basta con seleccionar el Quad Draw. Por defecto está activada la opción relax, simplemente pinta encima de la geometría y ordena la topología.

Y prácticamente estas son todas las herramientas que utilizo dentro de Maya 2014 para procesar mis scans 3D. Si tenéis alguna duda, aquí estoy :)

Vector displacement en Modo

Continuando con mis tips&tricks de Modo, cuento en este post como utilizar de forma adecuada vector displacement extraidos desde Mudbox en Modo.

- Una vez hayas terminado tu sculpt en Mudbox, asegúrate de tener el layer stack lo más limpio posible para agilizar el proceso de extracción.

- En las opciones de extracción del displacement, simplemente selecciona el modelo de alta y el modelo de baja resolución.

- Como vector space, selecciona Absolute si tu objeto es inanimado (props, environments) o Relative si tu objeto se va a deformar (personajes).

- Siempre que utilices vector displacement estaremos hablando de mapas de 32 bits.

- Exporta el mapa como EXR 32 bits.

- Antes de llevar el mapa a un software 3D, conviene chequearlo en una aplicación tipo Nuke.

- Una vez en Modo, selecciona la opción Linear UVs en las propiedades de geometría de tu asset y el nivel de subdivisión en render.

- Aplica un nuevo shader al asset.

- Añade un input de textura con el mapa vector displacement y pon el effect como Displacement.

- El Low and High Value deberían estar en 0% y 100% respectivamente.

- Se previsualizará el displacement en viewport.

Asegúrate que el gamma de la textura es 1.0 Recuerda que los mapas de displacement scalar 32 bits no necesitan ser corregidos trabajando con linear workflow.

- En las opciones del shader, bajo surface normal, tienes el parametro Displacement Distante. Como norma general 1m debería de darte el mismo resultado que en Mudbox.

- En las opciones de render puedes controlar la calidad del displacement (equivalente a shading rate de RenderMan).

- 1.0 es un buen parámetro, de ahí para abajo incrementarás demasiado los tiempos de render.

- Lanza un render test y todo debería funcionar como en Mudbox.